Музыка — это неотъемлемая часть нашей культуры и искусства, она переплетается с нашими эмоциями, переводит нас в другие миры и способна вызывать мощные впечатления. В наши дни мы сталкиваемся с невероятным развитием технологий, и одним из наиболее удивительных достижений в области музыки стала роль нейросетей в генерации звуковых произведений.

Нейросети, искусственные интеллекты и компьютерные алгоритмы буквально проникают в самую суть музыки, давая нам возможность создавать новые мелодии, гармонии и ритмы, которые поражают своей оригинальностью и великолепием. Это уже не просто программы, а настоящие создатели музыки, способные проникнуть в самые глубины наших восприятий и создать неповторимые аудиошедевры.

Роль нейросетей в генерации музыки нельзя недооценивать. Они способны анализировать огромные объемы данных, изучать музыкальные стили и элементы, исследовать творческие приемы композиторов и на основе этой информации создавать свои собственные композиции. Они могут оперировать различными жанрами и настроениями, ловко сочетая элементы классической музыки, джаза, рока, электронной музыки и многих других стилей.

Нейросети позволяют нам наслаждаться не только знакомыми мелодиями, но и открывать для себя совершенно новые звуковые ландшафты. Они создают музыку, которую никто раньше не слышал, но которая при этом вызывает такие же сильные эмоции и восторги, как и произведения известных композиторов. В мире, где мы окружены всевозможными звуками и музыкой, нейросети становятся настоящими творческими партнерами, помогая нам расширять границы искусства и создавать что-то удивительное.

Таким образом, роль нейросетей в генерации музыки стала невероятно значимой. Они предлагают нам новые, неожиданные звучания, позволяют нам экспериментировать с музыкальными идеями и открывают перед нами бесконечные возможности для творчества. Благодаря нейросетям музыка становится еще более удивительной и волнующей, и впереди нас ждут еще больше инноваций и открытий в этой захватывающей области.

Сегодня искусственный интеллект везде. Нейросети помогают нам в обработке фотографий, рекомендуют фильмы, музыку и вполне успешно творят. Хотя раньше считалось, что компьютеры не смогут заменить людей в создании чего-то. Оказывается, что всё-таки могут.

За последние несколько лет появились нейросети, которые умеют рисовать, делать музыку и даже создавать фильмы. Это привело к появлению виртуальных артистов.

Но самое главное – некоторые из них сами пишут песни.

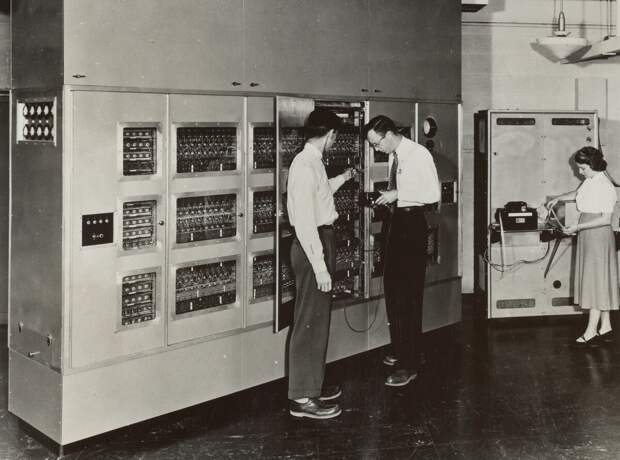

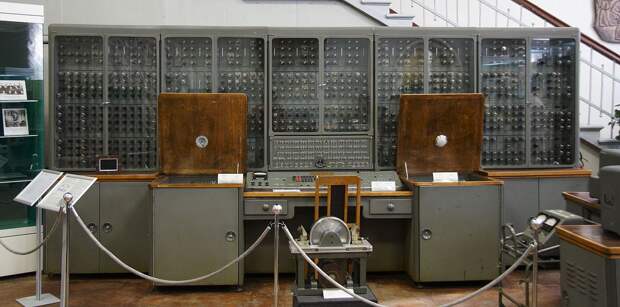

Первую песню компьютер написал в ещё в 1950-х

В 1957 году учёные из Университета Иллинойса выявили общие принципы в создании музыки разных жанров. Затем они перенесли эти данные в компьютер и написали программу, которая могла генерировать музыку.

Работало это так: алгоритм в случайном порядке генерировал ноты и ритмы. Представлены они были в виде чисел в диапазоне от 0 до 15. За каждым числом была привязана нота из двух октав диатонической гаммы До.

Были разрешены интервалы — унисон, октава, минорные или мажорные квинты, сексты, терции, чтобы избегать диссонанса. В итоге алгоритм смог написать своё произведение, которое назвали Сюитой Иллиака.

Это было настоящее достижение. В 1960-м советский академик Р. Х. Зарипов опубликовал статью «Об алгоритмическом описании процесса сочинения музыки». И в качестве примера привёл симфонию, которая была создана компьютером «Урал-1».

Да, звучат эти песни странно, далеко не человечно, но это только начало пути. С развитием искусственного интеллекта энтузиасты начали развивать более футуристичные проекты.

Появление первого цифрового музыканта

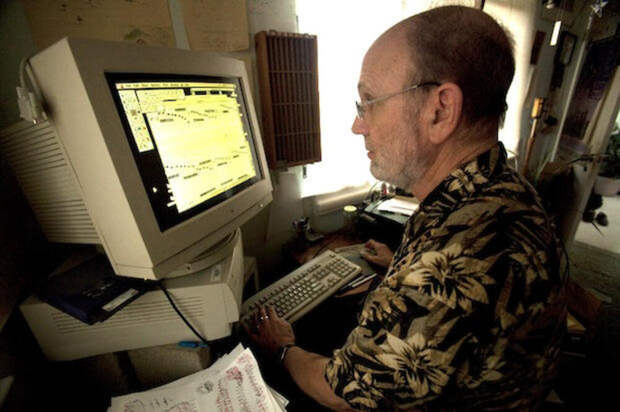

В 1997 году Дэвид Коуп, американский композитор и профессор факультета музыки в Университете Калифорнии представил миру Эмили Хоуэлл. Так зовут программу, которая умеет генерировать новую музыку на основе загруженных в неё композиций.

Работа над проектом началась в 1980 году, тогда Дэвид переживал творческий кризис. Ему было трудно создавать новую музыку, поэтому он решил попробовать сделать программу, которая могла бы искать уникальные моменты в уже написанных им композициях.

Коуп делал свою разработку на компьютере Power Macintosh 7500

Коуп делал свою разработку на компьютере Power Macintosh 7500

Он хотел освежить взгляд на своё творчество и, возможно, даже создать что-то новое на основе старого. Но в ходе разработки он понял, что программа может анализировать структуру музыкальных произведений любого композитора и выдавать новые пьесы, звучащие так же, как этот композитор написал бы их сам.

В итоге Эмили смогла создать уникальное произведение, которое в точности повторяло стиль Баха. Но на этом прогресс не остановился, и в течение 2000-х предприимчивые программисты и продюсеры возьмут эти странные, на первый взгляд, технологии к себе на вооружении.

Уже в начале 2000-х это привело к новому тренду в поп-музыке

Начало 2000-х отметилось компьютеризацией. На поп-сцене появились виртуальные артисты. В России удачным примером можно назвать Глюк’оZу, а на мировой сцене — Gorillaz. Из мемного — Crazy Frog.

Были и «вокалоиды» — цифровые певцы и певицы, чей голос был синтезирован, а на концертах перед зрителями представляли голограмму. Но все они не имели искусственного интеллекта, а за каждым из образов скрывались живые авторы.

А что если сам цифровой образ будет писать свои песни?

Одна из первых виртуальных певиц с искусственным интеллектом появилась в Британии

В 2016 году британский композитор иранского происхождения Эшем Куша (Ashem Kusha) представил виртуальную певицу Yona. У неё появился свой образ. Стиль текстов и музыки был выработан в ходе обучения нейросети. За основу был взят большой архив с абсолютно разной музыкой.

Его собрал сам Эшем. В него входили не только хиты, но и треки инди-исполнителей, стихи, аранжировки.

Это было необходимо, чтобы Yona могла делать музыку в разных жанрах и уметь комбинировать стили. По итогу искусственный интеллект научился писать музыку, совпадающую по смыслу с текстом. И наоборот

Да, красноречием и логикой строчки не блещут, но иногда бывают случайности, и Yona выдаёт глубокие метафоры. Лучше вообще рассматривать Yona с точки зрения потенциала, а не конечного продукта.

Для музыкальности пения был задействован автотюн. Голос Yona, к слову, также был создан искусственным интеллектом. Но какие параметры для него задавал Эшем — неизвестно.

Когда впервые услышал её песню, меня не покидало чувство, что это вовсе какое-то инопланетное творчество. Не иначе. Но на Yona прогресс не остановился.

Но Yona — не единственный ИИ-музыкант. Осенью 2019 года она выпустила два альбома в соавторстве с другими цифровыми артистами. А еще музыку пишет виртуальная инфлюенсерка Lil Miquela, у которой три миллиона подписчиков в инстаграме.

Чтобы создавать музыку с помощью Amper, вам не нужно знать ни музыкальную теорию, ни основы композиции.

У американской певицы Тэрин Саузерн (Taryn Southern), по ее признанию «нет традиционного музыкального бэкграунда». Но это не помешало ей выпустить в 2018 году целый альбом I AM AI, музыку для которого придумал искусственный интеллект.

«Обычно я находила красивый аккорд на пианино, — рассказывает Саузерн о том, как сочиняла до знакомства с ИИ, — и писала целую песню на основе этого аккорда, но не могла перейти к следующим нескольким аккордам, потому что не знала, как сыграть то, что слышала в голове».

Когда же она стала работать с Amper Music и другими ИИ-сервисами, процесс упростился. Теперь Саузерн сообщала ИИ, какой она видит будущую композицию, а он уже предлагал свои варианты. Саузерн могла отвергнуть тридцать версий, предложенных компьютером. Но когда он придумывал что-то, что действительно нравилось певице, она переносила получившиеся аудиодорожки в программу для создания аранжировок GarageBand, расставляла музыкальные фрагменты в нужном ей порядке и затем писала текст.

Некоторые, впрочем, могут спросить: «А велик ли в итоге вклад самой артистки? Не жульничество ли это?» Саузерн уверена, что всё по-честному. Нет одного-единственного способа создавать музыку, считает певица, и через двадцать лет, предсказывает она, такое «программирование» песен будет общим местом.

Одна виртуальная певица стала феноменом

Виртуальные модели не имеют изъянов во внешности

Виртуальные модели не имеют изъянов во внешности

Лил Микела (Lil Michela) — это имя вам о чём-нибудь говорит? У этой виртуальной певицы целых 4 млн подписчиков в Instagram, десятки миллионов прослушиваний в Spotify и контракты с большими брендами, такими как Calvin Klein и Samsung. Они приносят создателям цифровой модели около $7 млн в год.

Лил Микела появилась в 2016 и сначала многие считали, что это просто девушка, которая слишком сильно увлекается фильтрами. Но нет, в 2018 году вскрылся главный секрет — Лил Микела виртуальный персонаж. Об этом «каминг-ауте» стали писать мировые СМИ, которые принесли Микеле более широкую известность.

Известно, что девушка имела отношения с другим виртуальным парнем — моделью Blawko. Звучит, как некое безумие, но это уже даже не будущее, а настоящее. Единственное, что цифровые артисты, такие как Микела, являются лишь CGI-персонажами.

Они не имеют настоящего искусственного интеллекта и не могут генерировать музыку, писать посты и ещё что-либо.

Виртуальные артисты однозначно выгодны с точки зрения прибыли. Можно создать образ, который будет отвечать требованиям определённой аудитории и продаваться ей. Представьте комбинацию идеально работающей творческой нейросети Yona и продающий образ Микелы.

Мы ещё станем свидетелями таких проектов, это лишь вопрос времени.

Стриминговые сервисы могут когда-то начать писать музыку для каждого пользователя лично

Представьте, что если нейросетям с генерируемой музыкой, дать доступ к алгоритмам анализа вкусов пользователей. Такие есть во всех стриминговых сервисах вроде Apple Music и Spotify.

Причём они анализируют не только, что чаще слушает пользователь, какие жанры и что он лайкает. Алгоритмы в Spotify умеют понимать, какие сочетания нот нравятся пользователю, а какие нет. Обучившись на паттернах звучания, нейросети могут создавать музыку для каждого пользователя лично.

А если подключить к этому массив биометрических данных? Например, предоставив доступ к информации о пульсе с Apple Watch, нейросеть сможет лучше понимать, от каких песен ваше сердце начинает биться чаще. Так может появиться персонализированное искусство.

Представьте, что каждый день в Spotify будет обновляться плейлист с песнями, созданными специально для вас. Возможно, у каждого цифрового исполнителя будет даже свой цифровой образ, которой будет симпатичен снова именно вам.

Как пишет Юваль Ной Харари (יובל נח הררי) в своей книге «21 урок для 21 века»: «Алгоритму не обязательно писать музыку лучше Чайковского. Для начала достаточно превзойти Бритни Спирс (Britney Spears)».

И, отчасти, это не фантазия и не гипотетическое будущее, а вполне настоящее

Колыбельную для сына Илона Маска написал ИИ

В 2020 году российский стартап Endel и певица Граймс (бывшая жена Илона Маска) объявили о коллаборации. Кто не знает: Endel — это приложение генеративной музыки. Алгоритмы адаптируются к погоде, времени суток, пульсу, циркадному ритму и местоположению пользователя.

По словам Граймс, на это сотрудничество её подтолкнуло то, что «музыка для детей в целом всегда плохо написана». И эту музыку она не хотела включать своему сыну.

Руководитель стартапа Олег Ставицкий, бывший журналист «Игромании», рассказал, что певица записывала семплы по гайдлайнам, составленным композитором Endel. Затем отправляла материал программистам и звукорежиссёрам. Потом его обрабатывали и загружали в алгоритм. Всего процесс записи занял около полутора месяцев.

Конечный результат был неизвестен никому. Ни разработчикам Endel, ни самой Граймс. Единственное, что каждую из версий певица проверяла на своём сыне. Первые из них заставляли пятимесячного ребёнка плакать, но на итоговых миксах X Æ A-XII улыбался и быстро засыпал. Задача была достигнута.

Британский стартап Volchea создал программу, которая помогает транслировать музыку прямо из головы.

Попробуйте набитбоксить ритмический рисунок — Volchea сделает из него партию для барабанов. Или просто настучите ритм карандашом по кружке.

А если вам хочется сыграть с кем-то на пианино в четыре руки, на помощь придет искусственный интеллект Alice, созданный австралийским стартапом Popgun. Когда вы играете на пианино несколько нот, Alice, наученная на тысячах песен, сообразит, как подыграть вам. AI Duet — еще один похожий сервис. Чтобы понять, как это работает, просто попробуйте сами. Похожим путем пошел музыкант и программист Ден Тепфер (Dan Tepfer): он научил акустическое пианино аккомпанировать ему.

Заменит ли ИИ живых музыкантов?

«Мы всегда смотрели на творчество как на последний бастион человечности», — говорит Сиаваш Махдави (Siavash Mahdavi), глава одного из ИИ-стартапов AI Music. Сегодня музыканты выстраиваются в очередь, чтобы люди послушали их музыку. Последнее, чего они хотят, — это конкурировать с искусственным интеллектом, способным за секунду сочинить симфонию.

Многие музыканты со скепсисом относятся к ИИ, соглашается экс-глава Melodrive Валерио Велардо (Valerio Velardo). Проблема в том, что они не очень хорошо понимают, чем занимаются компании вроде Melodrive. Но немало и тех, кто разбирается в теме и нуждается в искусственном интеллекте.

В Велардо ИИ придумывал музыку для видеоигр, которую композиторы потом дорабатывали, как им вздумается. Поскольку сочинители в этой области работают в условиях жестких дедлайнов, к сервисам вроде Melodrive они относятся с большой симпатией, уверяет Велардо, добавляя:

«Они понимают, что ИИ не отнимет у них работу, а просто станет еще одним инструментом».

Какое будущее ждет ИИ в музыке

Представьте, что вы едете в переполненном вагоне метро и злитесь, потому что опаздываете на работу. Крошечный биометрический гаджет над вашим ухом замечает вашу тревогу и включает песню вашего любимого артиста, но изменяет ее так, чтобы она звучала более мягко и спокойно. По обратной связи гаджет замечает меняет ваши биометрические показатели и продолжает менять композицию, чтобы ее эффект был еще более благотворным.

Таким недалекое будущее музыкального ИИ видит Анмол Саксена (Anmol Saxena), глава стартапа Ashva WearTech, разрабатывающего «умную» одежду, например прибор помогающий поддерживать осанку. «На мой взгляд, есть большая вероятность, что стриминговая индустрия попробует предлагать функции, которые будут считывать такие показатели организма, как пульс, уровень стресса, частоту дыхания, может быть, даже неврологические сигналы», — говорит Саксена.

Неужели ИИ заменит музыкантов?

Искусственный интеллект вряд ли станет заменой людей в творчестве. Но вот частью его вполне. Хоть суперкомпьютер Deep Blue от IBM и обыграл в 1997 году Гарри Каспарова (Garry Kasparov) в шахматы, люди меньше или хуже играть в шахматы не стали.

Наоборот, при помощи компьютера теперь каждый может научиться играть в шахматы. И с музыкой, скорее всего, будет то же самое. Возможно, мы увидим какие-нибудь коллаборации певцов и систем искусственного интеллекта. Один задаёт тон песни и пишет текст, а другой генерирует под всё это дело музыку.

Но кажется, что проникновение нейросетей в эту сферу неизбежно. За последние несколько лет компьютеры, и ИИ в частности, стали частью нашей повседневной жизни. А что будет через десять лет? Можно только представить.

Какие времена, такое и творчество.

Свежие комментарии